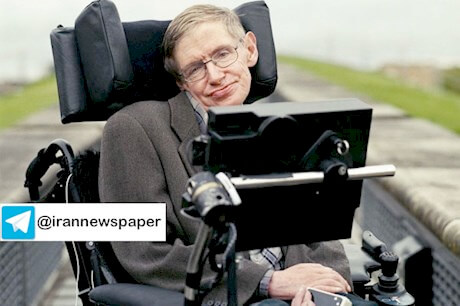

به گزارش ایران آنلاین، پروفسور هاوکینگ گفت: جامعه بین المللی باید برای مقابله با مسائل با هم همکاری کنند و به حرکت ها و خدمات مشترک بیندیشند کارهای مشترک برای مقابله با تهدیدات زیست محیطی ، تغییرات آب و هوایی و بیماری.

هاوکینگ همچنین نسبت به خطرات ناشی از دست رفتن شغل و بیکاری بر اثر توسعه پروژه هوش مصنوعی و ربات ها هشدار داد.

این فیزیکدان گفت: در غیاب حکمت و اخلاق تکنولوژی قادر به نابود کردن این سیاره است. لذا فناوری نوین باید منظور حفاظت از آینده بشریت کنترل شود.

وی در مورد خطرات ناشی از هوش مصنوعی گفت: یک مدیریت جهانی تنها امید ما است.

او می گوید: "منطق و اخلاق» تنها تکیه گاه ما برای مهار تهدید فزاینده جنگ هسته ای یا بیولوژیکی است.

او اظهار تاسف کرد که از ابتدای شکل گیری تمدن ها تجاوز و تعدی به عنوان عامل بقا دیده شده است.

او با اشاره به اصل تنازع بقا گفت این جزو ژن بشر امروز از زمان داروین تا به امروز شده است.

در حال حاضر، این خطر وجود دارد که شتاب تکنولوژی این خوی تجاوز را تشدید کند و همه ما به سمت جنگ هسته ای یا بیولوژیکی پیش برویم لذا نیاز به کنترل این میراث بشری از طریق عقل و اخلاق داریم.

به باور هاوکینگ ایده مدیریت جهانی ایده ای مناسب برای حرکت است اما در عین این ایده در بطن خود می تواند مسائل خاصی را بیافریند از جمله این که ممکن است به یک نظام مستبد جهانی تبدیل شود.

- 17

- 3